Zwischen zwei Welten – ein Selbstversuch

FOMO, fear of missing out. Es ist das Phänomen der Generation Z. Die Angst, etwas zu verpassen, hat sich so sehr in unseren Köpfen eingenistet, dass wir auch noch alten Klassenkamerad:innen von früher auf Instagram folgen, obwohl wir sie nie so wirklich mochten. Wir wollen aber wissen, was sie tun, wo sie sind und mit wem. Wir sind neugierig, gierig nach Neuem.

Diese Neugier hat unsere Reporterin Sina zu folgendem Selbstversuch gebracht, durch den sie den Algorithmus von Instagram, YouTube und Spotify besser kennenlernen wollte. Eine Woche. Zwei Smartphones. Drei Plattformen.

Was sie herausfinden wollte: Wie die Algorithmen der Plattformen auf ihre Nutzung reagieren und wie schnell sie dadurch in verschiedene Bubbles gerät.

Wie sie das gemacht hat: Auf zwei zurückgesetzten Smartphones hat sie Instagram, YouTube und Spotify installiert und jeweils einen neuen Account pro Gerät auf allen drei Plattformen angelegt. Ein Smartphone wurde zur lila Sina, das andere zur grünen Sina – passend zu den Stickern auf der Rückseite. Beide Sinas hatten die gleichen Merkmale: Anfang 20, weiblich, Eichstätter Studentin. In den ersten beiden Tagen, von Freitag bis Sonntag, haben die beiden Sinas auf den drei Plattformen genau die gleichen Inhalte konsumiert. Heißt: Sie haben die gleichen Beiträge geliked, die gleichen Videos geschaut, die gleiche Musik gehört und sind den gleichen Accounts gefolgt.

Die Accounts im Überblick

Instagram

- @tagesschau

- @br24

- @jodelapp

- @friends

- @sallyswelt

- @pamela_rf

- @lenagercke

- @samandmonicayoutube

- @uni.eichstätt

- @aktheke

- Accounts von Freund:innen

YouTube

- Tagesschau

- MrWissen2Go

- Sallys Welt

- Pamela Reif

Spotify

- TOP 50 Global (Charts)

- TOP 50 Deutschland (Charts)

- Ed Sheeran

- Justin Bieber

- Michael Jackson

Am Sonntag hat sich Sina von dieser Mainstream-Richtung verabschiedet.

Was dabei herauskam: Das erfahrt ihr in den Videos unter den jeweiligen Plattform-Abschnitten. Wichtig ist dabei nur eins: Egal, für welche Plattform ihr euch interessiert – der Algorithmus ist für alle drei eine wichtige Grundlage.

Algo- was?

Wenn es um Algorithmen geht, haben wir häufig das Bild einer „superschlauen“, roboterartigen Künstlichen Intelligenz vor Augen. Eigentlich ist ein Algorithmus jedoch etwas relativ Simples: Eine Kette von Anweisungen, die in einer festgelegten Reihenfolge ausgeführt werden, um ein Problem oder eine Aufgabe zu lösen. Vergleichbar mit einem Kochrezept. Man könnte ihn aus mathematischer Sicht auch als Berechnungsvorschrift definieren. Die von vielen verhasste Mitternachtsformel ist also lediglich der Algorithmus zum Lösen quadratischer Gleichungen einer bestimmten Form.

Da Probleme in unserem Alltag weit verbreitet sind, sind auch Algorithmen in unserer Welt allgegenwärtig. Zum Beispiel bei der Suche nach der schnellsten Route im Auto-Navi oder bei der Google-Suche.

Auf Social-Media-Plattformen spielen Algorithmen ebenfalls eine zentrale Rolle. Ihre Aufgabe ist es, Inhalte personalisiert zu filtern. Sie individualisieren die Plattformen, indem sie durch Faktoren wie Suchverlauf, Watchtime und Klickverhalten berechnen, was uns als Nutzer:innen am meisten interessiert.

Die Algorithmen sind so entwickelt, dass sie aufgrund der erhobenen Daten über uns die Inhalte heraussuchen, die für uns am interessantesten sind. Das muss nicht zwangsläufig bedeuten, dass diese uns immer am besten gefallen. Es geht darum, dass wir möglichst lange auf der Plattform bleiben und interagieren. Wir sind also nicht nur Konsument:innen, sondern auch selbst ein wertvolles Produkt. Genauer gesagt unsere Daten, die gezielt für Marketing genutzt werden, womit die Plattformen dann Geld verdienen.

Ich sehe was, was du nicht siehst

Spricht man also von einem Algorithmus, kann damit ein einfacher mathematischer Algorithmus zur Lösung von Gleichungen gemeint sein. Aber auch ein hochkomplexer Empfehlungsalgorithmus wie der von YouTube, der aus sogenannten Black Boxes besteht, in die man nicht hineinsehen kann. Denn wie die Algorithmen dort aus Datenmengen logische Zusammenhänge errechnen, ist meist nicht mal mehr für die Entwickler:innen nachvollziehbar.

Die riesigen Datenberge, die die Algorithmen von Social-Media-Plattformen analysieren, bezeichnet man als Big Data. Das muss man sich als den Versuch vorstellen, „Gesetzmäßigkeiten aus einem vermeintlich völlig unstrukturierten Haufen an Daten zu ziehen“, erklärt Jochim Selzer. Er ist Informatiker und Mitglied im Chaos Computer Club. Die Hacker:innenvereinigung ist eine der bedeutendsten Nichtregierungsorganisation bei Fragen rund um Computersicherheit. Selzer erklärt, dass man mithilfe von statistischen Verfahren versucht, Zusammenhänge aus riesigen Datenmengen herauszulesen, die bislang nicht ersichtlich waren. Diese Rechenleistungen übersteigen unsere Vorstellungen. Selzer betont aber, wie wichtig es ist, dass Menschen diese Analysen korrekt einordnen:

„Wir dürfen dabei das Großhirn nicht ausschalten.“

Jochim Selzer, IT-Experte vom Chaos Computer Club

Oftmals nutzen Plattformen für Big Data-Analysen sogenannte neuronale Netze, die mit einer Vielzahl von Algorithmen Muster aus Datenmengen herauslesen. Sie arbeiten nach demselben Prinzip wie das menschliche Gehirn. Wie bei einem Kind wird das „Gehirn“ Stück für Stück trainiert, ein bestimmtes Problem zu lösen. Die Netze sind so programmiert, dass sie selbst aus Fehlern lernen, bis sie ihre jeweilige Aufgabe fehlerfrei ausführen.

Unsere Reporterin Sina hat während ihres Selbstversuchs Daten produziert, aus denen die Algorithmen ihre Schlüsse gezogen haben. Sie wollte damit herausfinden, wie stark sie dadurch in Meinungs-Bubbles gelenkt wird. Wohin sie das auf Instagram geführt hat, seht ihr in diesem Video.

Instagram ‒ eine Bubble für alle, bitte

„Man verpasst, was den eigenen Horizont erweitern könnte, man verpasst andere Probleme und Phänomene und man verpasst einfach Informationen, die einem dabei helfen, andere Leute besser zu verstehen“, erklärt Sarah Sterz das Problem von Bubble-Bildung. Sie ist Informatikerin und forscht zur Ethik von Algorithmen. Wenn wir von Foto zu Foto und von Profil zu Profil klicken, merken wir nicht, dass der Content, der uns angezeigt wird, einseitig ist und uns hauptsächlich in unseren Meinungen bestätigt. „An sich sind diese Filter- oder Empfehlungsalgorithmen aber nicht schlecht, sondern sehr nützlich, um sich im Internet zurecht zu finden“, findet Sterz.

Der Algorithmus – was Instagram nicht verrät

Die Filteralgorithmen spielen auch auf Instagram eine große Rolle. Wie genau der Algorithmus Posts nach Relevanz sortiert, ist noch ziemlich unerforscht. Selbst die Organisation Algorithmwatch sammelt derzeit noch Daten, um den Instagram-Algorithmus zu durchblicken. Was man aber bereits weiß: Pro Sekunde werden dort 1.000 Posts geteilt.

Aktive monatliche Nutzer:innen

weltweit

Quelle: statista.com

Veröffentlichte Posts

pro Sekunde

Quelle: 99firms.com

Die Creator:innen – wenn der Content untergeht

Darunter auch die von Jennifer Hügel. Als Bookfluencerin rezensiert sie auf ihrem Kanal seit mehr als zwei Jahren Bücher und bedient damit eine kleine Nische auf Instagram. Der Algorithmus sorgt dafür, dass auch ihr Spartencontent anderen Leuten vorgeschlagen wird, rund 1.000 Leute haben ihren Kanal abonniert. Sie vermutet allerdings, dass es auch mehr sein könnten: „Ich kenne meine Wachstums-Fehler, ich könnte regelmäßiger Beiträge posten, mehr liken und teilen“, sagt Jennifer, mittlerweile sei ihr das Wachstum aber nicht mehr so wichtig.

Doch es gab Zeiten, da habe sie ziemlich viel getan, um dem Algorithmus zu gefallen. „Es gab Situationen, da habe ich Gespräche unterbrochen, um zu einer möglichst guten Tageszeit zu posten“, erzählt sie. Der Druck des Algorithmus führte so weit, dass sie ihren Instagram-Kanal löschte, nachdem sie beschlossen hatte, nicht nur Büchercontent zu posten. Viele Leute entfolgten ihr. Der Algorithmus war verwirrt von dem unterschiedlichen Content und konnte sie nicht mehr eindeutig einordnen, „der Account ist richtig gestorben.“

Seit einem Jahr postet sie ihren Content jetzt auf einem neuen Account, egal ist ihr der Algorithmus aber immer noch nicht. Gerne würde sie wieder aus der Büchersparte ausbrechen und ihre Meinung zu verschiedenen Themen abgeben – doch der Algorithmus hält sie erneut davon ab.

Die Gesellschaft – wenn Information subjektiv wird

Wo genau ist das Problem, wenn sie einen anderen Instagram-Feed hat als er? Eigentlich ist es doch gut, wenn jede:r das angezeigt bekommt, was ihn oder sie interessiert. Die Netflix-Dokumentation „The Social Dilemma“ erklärt das Problem an einem einfachen Beispiel:

Stell dir vor, du suchst auf Wikipedia nach einem Begriff oder einem Ereignis und bekommst einen komplett anderen Wikipedia-Eintrag angezeigt als die Person, die genau das Gleiche gesucht hat, aber woanders wohnt, ein anderes Geschlecht hat, ärmer oder reicher als du bist. Stell dir vor, Wikipedia würde selbst aussuchen, ob dieser eine Fakt in dem Eintrag relevant für dich ist oder nicht. Und genauso funktioniert der personalisierte Feed auf Instagram – und auch auf allen anderen sozialen Netzwerken.

Warum das auch auf YouTube, gerade in Zeiten einer Pandemie zu Problemen führen kann, hat Sina in ihrem Selbstversuch aus erster Hand erfahren.

YouTube ‒ alle schauen in die eigene Röhre

Aktive monatliche Nutzer:innen

weltweit

Quelle: youtube.com

Hochgeladenes Videomaterial

pro Sekunde

Quelle: tubefilter.com

Die YouTube-Suchergebnisse aus unserem Selbstversuch führten beim Thema Impfen in die gleiche Denkrichtung – trotz unterschiedlicher Nutzung. Das mag im ersten Moment überraschen. Auf den zweiten jedoch weniger:

Eine ablehnende Haltung gegenüber Impfungen gibt es sowohl in progressiven als auch konservativen Bubbles. Deswegen kann es dazu kommen, dass selbst politisch unterschiedlich eingestellte Menschen in bestimmten Fällen ähnliche Inhalte angezeigt bekommen. Dazu kommt, dass YouTube die vorgeschlagenen Inhalte bei einer gezielten Suche deutlich vielfältiger gestaltet als die im Entdecken-Feed.

Der Algorithmus – ein „Gehirn“, das uns immer besser kennenlernt

Vereinfacht gesagt, kann man den YouTube-Algorithmus als Empfehlungssystem bezeichnen, ähnlich wie bei Spotify und Netflix. Laut YouTube konsumieren wir Nutzer:innen dort zusammen eine Milliarde Stunden Videomaterial – pro Tag. Jede Sekunde kommen mehrere Stunden Material hinzu. YouTube analysiert diese unvorstellbaren Datenmengen und bereitet sie für jede:n von uns personalisiert auf.

Dabei weiß YouTube nicht, wie wir uns beim Schauen gerade fühlen. Der Algorithmus versucht unsere Stimmung anhand unseres Nutzungsverhaltens auf der Seite zu ermitteln. Ob man beispielsweise ein Video gut oder schlecht bewertet, spielt dabei keine Rolle. Das geht aus einem Paper des Google-Konzerns hervor. Was zählt, ist die Watchtime, wie lange wir Videos schauen. Schauen wir sie in voller Länge, wird uns Ähnliches empfohlen.

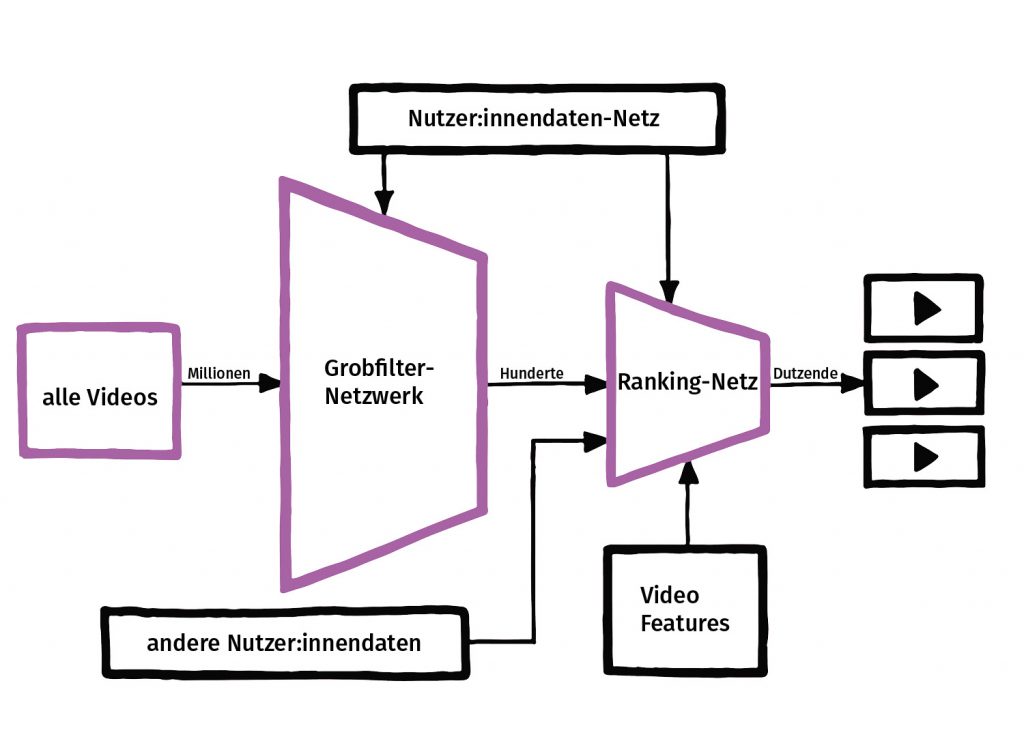

Der YouTube-Algorithmus

Im Groben besteht er aus mehreren neuronalen Netzen, die zusammenarbeiten. Jedes ist so programmiert, dass es nach und nach lernt, eine Aufgabe immer besser zu lösen.

Auf YouTube stehen Millionen Videos zur Verfügung, aus denen ein neuronales Grobfilter-Netzwerk einige Hundert berechnet, die für uns persönlich relevant sind. Diese Vorauswahl wird dann in einem Ranking-Netz in eine für uns bestmögliche Reihenfolge gebracht. Diese beiden Netze verwenden Informationen aus dem Nutzer:innendaten-Netz. Aus unserem Klick- und Suchverhalten oder unserem Verlauf generiert YouTube jede Menge Daten über uns. Aus all diesen Daten wird dann berechnet, welches Video bei uns persönlich am höchsten gerankt wird. Aus jeder Empfehlung, ob sie uns gefallen hat oder nicht, lernt der Algorithmus dazu. Dabei lernt er jede:n von uns immer besser kennen und schafft es so, uns fast immer das Video anzuzeigen, das uns am meisten interessiert.

Die Creator:innen – das Abo, ein Relikt aus vergangener Zeit?

Früher spielten auf YouTube noch Abozahlen und Likes eine wichtige Rolle, heute ist es jedoch beinahe irrelevant, einen Kanal zu abonnieren. „Ich würde mir wünschen, dass meine Videos meinen Abonnenten mehr angezeigt werden. Der Einfluss eines Abonnements auf die Anzeige eines Videos ist zu klein“, findet Jonathan Guthy.

Er betreibt einen Wrestling-Kanal mit über 100.000 Abonnent:innen. Jonathan bedient mit Wrestling thematisch eine Nische. Nur 40 Prozent seiner Zuschauer:innen haben seinen Kanal abonniert und bekommen seine Videos im Abo-Feed zu sehen. Nicht allen Abonennt:innen werden seine Videos auf der Startseite empfohlen. Das kostet ihm letztlich Aufrufe. Denn diese treue „Nischen-Zuschauerschaft“ würde laut Jonathan fast all seine Inhalte schauen – sofern sie ihnen der Algorithmus empfiehlt.

Die Gesellschaft – wenn uns der Algorithmus den Spiegel vorhält

Doch YouTube hat ein Problem: „Es gibt viel zu viel Content“, sagt Cedric Mössner, der als studierter Informatiker auf seinem YouTube-Kanal alle möglichen Themen rund um Informatik beleuchtet. Die Ansprüche von uns als Zuschauer:innen seien gestiegen, das wiederum sorge für immer extremere Inhalte und Titel, da anderweitig kaum noch Interesse generiert werden könne. „Mit Inhalten von vor zehn Jahren kann man heute nicht mehr punkten“, weiß Mössner.

Der YouTube-Algorithmus verstärkt aber lediglich die Interessen der Nutzer:innen. In Zeiten einer gesellschaftlichen Polarisierung ist er nur ein Spiegelbild davon. Mössner erklärt das so: „Wenn sich Menschen radikalisieren, radikalisiert sich auch der Algorithmus. Würde jeder über zehn Monate den Content von vor zehn Jahren schauen, würde sich der Algorithmus dahingehend normalisieren.“ Es liegt also immer noch in unserer Hand.

Social-Media-Plattformen halten uns meist in unseren Bubbles, damit wir möglichst lange online bleiben. Das möchte auch Spotify von uns Hörer:innen. Wie sich in Sinas Selbstversuch zeigt, hat das noch einmal ganz andere Folgen.

Spotify ‒ ist das Kunst oder kann das weg?

Aktive monatliche Nutzer:innen

weltweit

Quelle: statista.com

Verfügbare Songs

auf der Plattform

Quelle: statista.com

„Je enger die formalen Vorgaben, umso eingeengter ist man in der Kreativität“, sagt Matthias Schröder. Er ist Professor für Musikmanagement an der Hochschule für Musik in Detmold und blickt mit Sorge auf die zunehmende Marktmacht von Algorithmen in der Musikbranche.

Songs, die nicht länger als 3:30 Minuten dauern, Intros, die 20 Sekunden oder kürzer sind und die direkt mit dem Refrain beginnen: All diese Parameter bestimmen heutzutage, wie erfolgreich ein Lied sein kann.

Es ist aber nicht erst seit Spotify, dass Druck auf den Musikmarkt und damit auf die Künstler:innen da ist, erklärt Schröder: „Schon im Radio sollte ein Song nicht länger als drei Minuten lang sein, 12 Minuten Songs wurden nicht gespielt.“ Was bei Spotify aber besonders ist: Erst ab 30 Sekunden Abspieldauer zählt ein Lied als angehört und genau deshalb muss es „mit einem Knalleffekt starten“, sagt Schröder.

Der Algorithmus – behind the stage

Das allein ist für den Spotify-Algorithmus entscheidend: Hören wir uns das Lied an, wenn ja, wie lange und wie oft? Teilen wir es? Gefällt es uns so gut, dass wir es in unsere Lieblingssongs aufnehmen oder in unsere Playlists packen? Mit diesen Informationen erstellt Spotify ein individuelles Taste Profile für uns, das unser Nutzungsverhalten widerspiegelt. Diese Daten werden dann wiederum mit denen anderer Nutzer:innen verglichen. Gibt es Überschneidungen im Musikgeschmack, schlägt uns der Algorithmus Lieder vor, die andere auch gerne hören.

Mix der Woche, Release Radar, personalisierte Mixtapes: All diese Playlists werden vom Spotify-Algorithmus erstellt und die Voraussetzung dafür, dass sie da rein kommen, ist vor allem eins: Interaktion. Performt ein Song gut, vor allem kurz nachdem er veröffentlicht wurde, merkt das der Algorithmus und pusht ihn weiter nach oben.

Die musikalische Zwangsjacke

Aber soll Musik nicht vor allem Emotionen wecken, anstatt komplett durchanalysiert zu werden? Ja, sagt Spotify: Sogar Emotionen versucht deren Künstliche Intelligenz zu kategorisieren. Damit dabei Lieder nicht aus dem Raster fallen, könne es eventuell dazu kommen, dass Künstler:innen nicht mehr so komplexe Musik komponieren und produzieren würden, befürchtet Musikprofessor Schröder.

Ganz auf die Meinung von Menschen verzichtet Spotify jedoch nicht – die sogenannten Editorial Playlists werden von Spotify-Redakteur:innen erstellt. Doch auch hier spielen die Analytics, also die Art und Weise, wie gut ein Lied bei den Hörer:innen ankommt, eine große Rolle.

Was macht Spotify also? Durch vorgeschlagene Songs und individualisierte Playlists werden wir in unserem Musikgeschmack immer weiter bestärkt und hören immer wieder das Gleiche. Das führt dazu, dass auch immer ähnlichere Produktionen nachgefragt werden, denen die Künstler:innen dann gerecht werden (müssen). „Letzten Endes ist es eine Manipulation aufgrund eines vermeintlichen Geschmacks“, sagt Schröder. Er befürchtet, dass „durch die formale Zwangsjacke“ eher der Mainstream der jeweiligen Musiksparten gefördert werde.

Die Creator:innen – wie viel Statistik hält Kunst aus?

Max Stulle lässt sich davon wenig beeindrucken. Gemeinsam mit Justus Fischer ist er unter dem Pseudonym Die Mode auf Spotify unterwegs und hat erst vor Kurzem seinen dritten Song releast. Den haben die beiden allerdings schon geschrieben, bevor sie überhaupt wussten, ob sie ihre Lieder auf Spotify hochladen. Trotzdem sind die beiden sich einig, zu lange sollte der Song nicht sein, genauso wie das Intro: „Die Leute sollen nicht wegklicken, bevor der gute Teil des Lieds kommt“, erklärt Max. Trotzdem sagt er: „Grundsätzlich machen wir unser Ding und gehen unserer kreativen Vision nach und scheißen ziemlich drauf, was jetzt für den Algorithmus gut ist oder nicht.“

Anders ist es bei Victor Fricke, der unter dem Namen Radoux vor ein paar Monaten seinen dritten Song auf Spotify veröffentlicht hat: „Wenn ich was release, schau ich schon, dass mir der Algorithmus in die Hände spielt“, sagt Victor. Er achtet beispielsweise darauf, dass der Song schon einen Monat vor dem Release auf Spotify hochgeladen ist. Dadurch könne er an große Playlists gepitcht werden und mit einer höheren Wahrscheinlichkeit auch darin landen. Doch die Unsicherheit bleibt: „Es ist ziemlich schwer, den Algorithmus zu beeinflussen“, findet Victor.

Die Gesellschaft – wie man dem Mainstream entkommt

Doch der Algorithmus muss nicht das alles Entscheidende sein: „Wenn man Spotify bewusst nutzt, kann es vielfältig sein“, sagt Musikprofessor Matthias Schröder. Diese riesige Musikdatenbank erfordere vor allem mündige Nutzer:innen. Solange man sich von Spotify mit Musik beliefern lasse, füttere man den Algorithmus nur weiter mit der eigenen Mainstream-Meinung. „Aber es gab ja schon immer Bewegung und Gegenbewegung: Wenn Mainstream von Spotify gefördert wird, wird es auch wieder Leute geben, die ihre Musik bewusst auswählen“, erklärt Schröder.

Der böse Algorithmus?

Algorithmen, KI, deep machine learning – all diese technischen Berechnungsprozesse bestimmen mittlerweile unsere Entscheidungen und unser Leben. Sie helfen uns, schränken uns aber auch gleichzeitig ein. Besonders dann, wenn wir nicht wissen, dass hier gerade schon mal ein Algorithmus die Vorauswahl für uns getroffen hat.

Joost van Loon nennt das den „Mythos der Entscheidungsfreiheit.“ Er ist Professor für Soziologie an der Katholischen Universität Eichstätt-Ingolstadt und erklärt, dass man zwar das Gefühl habe, man könne selbständig entscheiden, welchen Post man liket, man aber immer nur eine Auswahl zu sehen bekomme und nie die ganze Wahrheit.

Diese Auswahl hat insbesondere bei politischen Themen schwerwiegende Auswirkungen auf uns als Gesellschaft: „Sie führt zu einem Zusammenbruch der Öffentlichkeit“, sagt van Loon.

„Es gibt eigentlich keine Öffentlichkeit mehr.“

Joost van Loon, Professor für Soziologie

Wir fragen uns, wie kann es sein, dass er oder sie glaubt, beim Impfen bekäme man Chips eingepflanzt? Wie kann es sein, dass manche denken, Corona wäre von der Regierung erfunden worden? Die Antwort ist so einfach wie erschreckend: Jede:r hat online eine eigene Realität, jede:r kann auf seinem oder ihrem sozialen Medium andere Informationen erhalten als die Person, mit der er oder sie befreundet ist. Das spaltet uns als Gesellschaft.

„Politisch gesehen ist das eine Katastrophe“, sagt van Loon. Wenn wir diese Gefahr allerdings erkennen und sie ändern wollen, anstatt sie zu bagatellisieren, dann sei die Lage nicht hoffnungslos.

Mehr Macht den Menschen

Was wir tun können? Bewusst unterschiedlichen Medienhäusern auf Instagram folgen, unsere Musik gezielt auswählen und ausdrücklich nach beiden Ansichten zu einer Debatte bei YouTube suchen. Dann verlieren wir uns nicht mehr in nur einer Echokammer.

„So Boomer-mäßig das auch klingt: man kann auch mal offline sein“, findet Ethik- und Informatik-Expertin Sarah Sterz. Aber nicht nur wir sind in der Pflicht, unser Verhalten zu ändern. Auch die Plattformen der sozialen Medien sieht Sterz in der Bringschuld. Sie wünscht sich mehr Transparenz für Nutzer:innen und fordert exakte Informationen darüber, warum uns der Algorithmus genau diesen Post vorschlägt.

„Ich würde mich nie hinstellen und sagen:

‚Algorithmen verbieten, denn sie sind ein Gräuel!’ “

Jochim Selzer, IT-Experte vom Chaos Computer Club

Auch Informatik-Experte Jochim Selzer wünscht sich transparentere Entscheidungsfindungen der Algorithmen: „Ich würde mich nie hinstellen und sagen ‚Algorithmen verbieten, denn sie sind ein Gräuel!‘, denn dann bekomme ich sehr viel Content angezeigt, der mich nicht die Bohne interessiert.“